Hallo Zusammen

Wir haben vor kurzem einen Server mit Proxmox (Version aktuell 9.1.5) ausgestattet und drei Windows Server 2025 darauf installiert.

Einer davon fungiert als RDP Host Server.

Soweit hat auch alles geklappt mit der Installation, auch laufen alle Server.

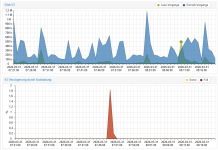

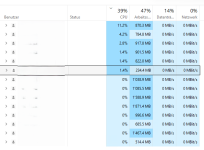

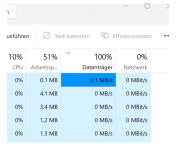

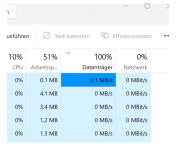

Nun ist uns aber aufgefallen das vor allem der RDP Server bei kleinsten Aktionen eine sehr hohe Festplattenauslastung aufweist.

Zum testen haben wir mal eine Webseite geöffnet (Blick.ch) und die Festplattenaktivität gingt blitzartig auf 100% für ca. 15s.

Der Durchsatz lag aber nur bei 0.1Mbit/s.

Wird wiederum eine 450MB Datei aus dem Internet gezogen dann ist diese in ca. 10s heruntergeladen.

System:

Host: HPE ML110 Gen11 (Gold 5416S 16 Cores)

RAM: 128GB

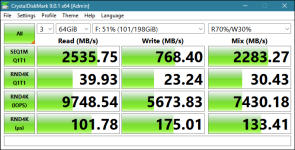

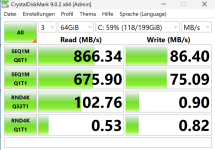

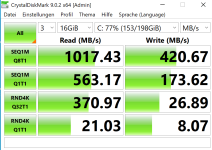

Datenträger: SSD WD Red 1TB (jeweils in zwei Raid 1)

Anbindung an Proxmox mit HPE HW Raid Controller p408i

Datastorage: LVM

Der RAM und CPU liegen entsprechend im grünen Bereich egal ob 5 oder 10 User auf dem RDP sind.

Nun sind wir uns unsicher ob es einfach ein Anzeige Problem ist oder es wirklich irgendwo klemmt.

Gemerkt wurde es aufgrund dessen das Outlook extrem lange hatte bis es geöffnet wurde, denn auch wenn man Outlook auf dem RDP öffnet geht die Auslastung des Speichers gleich auf 100%.

Auch stürzt Outlook oder generell Office sehr oft ab, das konnte innerhalb von 15min vier mal beobachtet werden.

Wir vermuten das es was mit der Überlastung der Festplatten zu tun haben könnte.

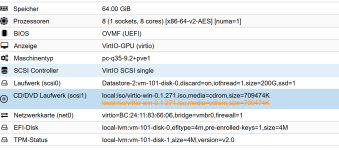

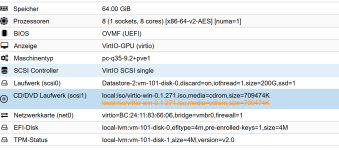

Anbei die Einstellungen welche aktuell vorhanden sind.

VirtIO und Guest Agent sind installiert. (Version virtio-win-0.1.271-1)

Da es unser erstes Produktives System ist, sind wir nicht in allen Punkten so sattelfest. Die Einstellungen haben sicher noch Luft nach oben. ;-)

Darum würde ich mich über eure Hilfe freuen und bin über jeden Input froh. Vielleicht braucht es noch mehr Infos, last mich das bitte wissen.

Da das System bereits im Einsatz ist können wir nur behutsam Änderungen vornehmen.

Vielen Dank für eure Hilfe.

Wir haben vor kurzem einen Server mit Proxmox (Version aktuell 9.1.5) ausgestattet und drei Windows Server 2025 darauf installiert.

Einer davon fungiert als RDP Host Server.

Soweit hat auch alles geklappt mit der Installation, auch laufen alle Server.

Nun ist uns aber aufgefallen das vor allem der RDP Server bei kleinsten Aktionen eine sehr hohe Festplattenauslastung aufweist.

Zum testen haben wir mal eine Webseite geöffnet (Blick.ch) und die Festplattenaktivität gingt blitzartig auf 100% für ca. 15s.

Der Durchsatz lag aber nur bei 0.1Mbit/s.

Wird wiederum eine 450MB Datei aus dem Internet gezogen dann ist diese in ca. 10s heruntergeladen.

System:

Host: HPE ML110 Gen11 (Gold 5416S 16 Cores)

RAM: 128GB

Datenträger: SSD WD Red 1TB (jeweils in zwei Raid 1)

Anbindung an Proxmox mit HPE HW Raid Controller p408i

Datastorage: LVM

Der RAM und CPU liegen entsprechend im grünen Bereich egal ob 5 oder 10 User auf dem RDP sind.

Nun sind wir uns unsicher ob es einfach ein Anzeige Problem ist oder es wirklich irgendwo klemmt.

Gemerkt wurde es aufgrund dessen das Outlook extrem lange hatte bis es geöffnet wurde, denn auch wenn man Outlook auf dem RDP öffnet geht die Auslastung des Speichers gleich auf 100%.

Auch stürzt Outlook oder generell Office sehr oft ab, das konnte innerhalb von 15min vier mal beobachtet werden.

Wir vermuten das es was mit der Überlastung der Festplatten zu tun haben könnte.

Anbei die Einstellungen welche aktuell vorhanden sind.

VirtIO und Guest Agent sind installiert. (Version virtio-win-0.1.271-1)

Da es unser erstes Produktives System ist, sind wir nicht in allen Punkten so sattelfest. Die Einstellungen haben sicher noch Luft nach oben. ;-)

Darum würde ich mich über eure Hilfe freuen und bin über jeden Input froh. Vielleicht braucht es noch mehr Infos, last mich das bitte wissen.

Da das System bereits im Einsatz ist können wir nur behutsam Änderungen vornehmen.

Vielen Dank für eure Hilfe.