Hallo Zusammen,

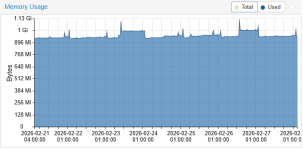

leider ist es mir jetzt innerhalb 2 Wochen schon 3x passiert, dass mein DNS nicht mehr funktioniert. Nach kurzer Suche habe ich gemerkt, dass der Adguard im LCX Container auf 100% Auslastung war. Ich habe den Container neu gestartet und dann ging es wieder. Aber das ist ja keine Lösung. Habt jemand auch schon einmal das Problem bemerkt?

Gibt es eine Fehlerursache oder noch schöner, eine Lösung?

Folgendes ist mir im Syslog aufgefallen:

Mache ich hier etwas falsch?

Danke für eure Hilfe.

Ronny

P.S. Ich habe jetzt auch den Unifi Controller mal neu gestartet, aber dort eigentlich keine Auffälligkeiten entdeckt.

Virtual Environment 7.4-15

leider ist es mir jetzt innerhalb 2 Wochen schon 3x passiert, dass mein DNS nicht mehr funktioniert. Nach kurzer Suche habe ich gemerkt, dass der Adguard im LCX Container auf 100% Auslastung war. Ich habe den Container neu gestartet und dann ging es wieder. Aber das ist ja keine Lösung. Habt jemand auch schon einmal das Problem bemerkt?

Gibt es eine Fehlerursache oder noch schöner, eine Lösung?

Folgendes ist mir im Syslog aufgefallen:

Code:

Jul 01 11:21:01 pve audit[3760945]: AVC apparmor="STATUS" operation="profile_load" profile="/usr/bin/lxc-start" name="lxc-102_</var/lib/lxc>" pid=3760945 comm="apparmor_parser"

Jul 01 11:21:01 pve kernel: audit: type=1400 audit(1688203261.403:47): apparmor="STATUS" operation="profile_load" profile="/usr/bin/lxc-start" name="lxc-102_</var/lib/lxc>" pid=3760945 comm="apparmor_parser"

Jul 01 11:21:01 pve systemd-udevd[3760738]: ethtool: autonegotiation is unset or enabled, the speed and duplex are not writable.

Jul 01 11:21:01 pve systemd-udevd[3760738]: Using default interface naming scheme 'v247'.

Jul 01 11:21:01 pve systemd-udevd[3760738]: ethtool: autonegotiation is unset or enabled, the speed and duplex are not writable.

Jul 01 11:21:01 pve systemd-udevd[3760738]: ethtool: autonegotiation is unset or enabled, the speed and duplex are not writable.

Jul 01 11:21:01 pve systemd-udevd[3760977]: ethtool: autonegotiation is unset or enabled, the speed and duplex are not writable.

Jul 01 11:21:01 pve systemd-udevd[3760977]: Using default interface naming scheme 'v247'.

Jul 01 11:21:01 pve kernel: vmbr1: port 3(fwpr102p0) entered blocking state

Jul 01 11:21:01 pve kernel: vmbr1: port 3(fwpr102p0) entered disabled state

Jul 01 11:21:01 pve kernel: device fwpr102p0 entered promiscuous mode

Jul 01 11:21:01 pve kernel: vmbr1: port 3(fwpr102p0) entered blocking state

Jul 01 11:21:01 pve kernel: vmbr1: port 3(fwpr102p0) entered forwarding state

Jul 01 11:21:01 pve kernel: fwbr102i0: port 1(fwln102i0) entered blocking state

Jul 01 11:21:01 pve kernel: fwbr102i0: port 1(fwln102i0) entered disabled state

Jul 01 11:21:01 pve kernel: device fwln102i0 entered promiscuous mode

Jul 01 11:21:01 pve kernel: fwbr102i0: port 1(fwln102i0) entered blocking state

Jul 01 11:21:01 pve kernel: fwbr102i0: port 1(fwln102i0) entered forwarding state

Jul 01 11:21:01 pve kernel: fwbr102i0: port 2(veth102i0) entered blocking state

Jul 01 11:21:01 pve kernel: fwbr102i0: port 2(veth102i0) entered disabled state

Jul 01 11:21:01 pve kernel: device veth102i0 entered promiscuous mode

Jul 01 11:21:01 pve kernel: eth0: renamed from vethtKcPLb

Code:

Jul 01 11:20:16 pve systemd-udevd[3758882]: ethtool: autonegotiation is unset or enabled, the speed and duplex are not writable.

Jul 01 11:20:16 pve systemd-udevd[3758882]: ethtool: autonegotiation is unset or enabled, the speed and duplex are not writable.

Jul 01 11:20:16 pve systemd-udevd[3758905]: ethtool: autonegotiation is unset or enabled, the speed and duplex are not writable.

Jul 01 11:20:16 pve systemd-udevd[3758905]: Using default interface naming scheme 'v247'.Mache ich hier etwas falsch?

Danke für eure Hilfe.

Ronny

P.S. Ich habe jetzt auch den Unifi Controller mal neu gestartet, aber dort eigentlich keine Auffälligkeiten entdeckt.

Virtual Environment 7.4-15