Hallo zusammen,

ich habe aktuelle zwei Proxmox Server und einen PBS am laufen.

Da der erste Proxmoxserver probleme macht habe ich einen zweiten aufgesetzt und wollte die Bakups vom PBS einspielen.

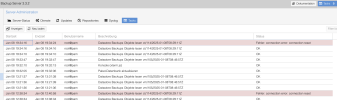

Bei zwei Backups macht das Einpielen Probleme. Ich bekomme immer diese Meldung:

Ich habe auch schon die Netzwerkübertarung verinnert, was aber auch nichts gebracht hat. Kann es sein das beim neuen Server ein storage oder was anderes fehlt? Ich glaube die zwei Backups sind VMś und die anderen sind CT. Hat eventuell einer eine Hilfreiche Idee?

ich habe aktuelle zwei Proxmox Server und einen PBS am laufen.

Da der erste Proxmoxserver probleme macht habe ich einen zweiten aufgesetzt und wollte die Bakups vom PBS einspielen.

Bei zwei Backups macht das Einpielen Probleme. Ich bekomme immer diese Meldung:

Code:

Header

Proxmox

Virtual Environment 8.3.2

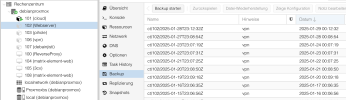

Storage 'Proxmoxbs' auf Knoten 'debianproxmox'

Suche:

Logs

()

Formatting '/var/lib/vz/images/104/vm-104-disk-0.raw', fmt=raw size=34359738368 preallocation=off

new volume ID is 'local:104/vm-104-disk-0.raw'

restore proxmox backup image: /usr/bin/pbs-restore --repository root@pam@192.168.0.91:Backups vm/105/2025-01-06T23:15:58Z drive-scsi0.img.fidx /var/lib/vz/images/104/vm-104-disk-0.raw --verbose --format raw --skip-zero

connecting to repository 'root@pam@192.168.0.91:Backups'

open block backend for target '/var/lib/vz/images/104/vm-104-disk-0.raw'

starting to restore snapshot 'vm/105/2025-01-06T23:15:58Z'

download and verify backup index

progress 1% (read 343932928 bytes, zeroes = 8% (29360128 bytes), duration 3 sec)

progress 2% (read 687865856 bytes, zeroes = 4% (29360128 bytes), duration 6 sec)

progress 3% (read 1031798784 bytes, zeroes = 2% (29360128 bytes), duration 10 sec)

progress 4% (read 1375731712 bytes, zeroes = 2% (29360128 bytes), duration 15 sec)

progress 5% (read 1719664640 bytes, zeroes = 1% (29360128 bytes), duration 18 sec)

progress 6% (read 2063597568 bytes, zeroes = 1% (29360128 bytes), duration 23 sec)

progress 7% (read 2407530496 bytes, zeroes = 1% (29360128 bytes), duration 26 sec)

progress 8% (read 2751463424 bytes, zeroes = 1% (29360128 bytes), duration 32 sec)

progress 9% (read 3095396352 bytes, zeroes = 0% (29360128 bytes), duration 36 sec)

progress 10% (read 3439329280 bytes, zeroes = 0% (29360128 bytes), duration 42 sec)

progress 11% (read 3783262208 bytes, zeroes = 0% (37748736 bytes), duration 46 sec)

progress 12% (read 4127195136 bytes, zeroes = 0% (37748736 bytes), duration 51 sec)

progress 13% (read 4466933760 bytes, zeroes = 1% (54525952 bytes), duration 54 sec)

progress 14% (read 4810866688 bytes, zeroes = 1% (54525952 bytes), duration 60 sec)

progress 15% (read 5154799616 bytes, zeroes = 1% (54525952 bytes), duration 64 sec)

progress 16% (read 5498732544 bytes, zeroes = 0% (54525952 bytes), duration 69 sec)

progress 17% (read 5842665472 bytes, zeroes = 0% (54525952 bytes), duration 75 sec)

progress 18% (read 6186598400 bytes, zeroes = 0% (54525952 bytes), duration 80 sec)

progress 19% (read 6530531328 bytes, zeroes = 1% (79691776 bytes), duration 86 sec)

progress 20% (read 6874464256 bytes, zeroes = 1% (79691776 bytes), duration 95 sec)

progress 21% (read 7218397184 bytes, zeroes = 1% (79691776 bytes), duration 106 sec)

progress 22% (read 7562330112 bytes, zeroes = 1% (79691776 bytes), duration 115 sec)

progress 23% (read 7906263040 bytes, zeroes = 1% (79691776 bytes), duration 121 sec)

progress 24% (read 8250195968 bytes, zeroes = 0% (79691776 bytes), duration 128 sec)

progress 25% (read 8589934592 bytes, zeroes = 0% (79691776 bytes), duration 134 sec)

progress 26% (read 8933867520 bytes, zeroes = 1% (92274688 bytes), duration 142 sec)

progress 27% (read 9277800448 bytes, zeroes = 0% (92274688 bytes), duration 151 sec)

progress 28% (read 9621733376 bytes, zeroes = 0% (92274688 bytes), duration 160 sec)

progress 29% (read 9965666304 bytes, zeroes = 0% (92274688 bytes), duration 168 sec)

progress 30% (read 10309599232 bytes, zeroes = 0% (92274688 bytes), duration 175 sec)

progress 31% (read 10653532160 bytes, zeroes = 0% (92274688 bytes), duration 182 sec)

progress 32% (read 10997465088 bytes, zeroes = 0% (92274688 bytes), duration 190 sec)

progress 33% (read 11341398016 bytes, zeroes = 0% (92274688 bytes), duration 199 sec)

progress 34% (read 11685330944 bytes, zeroes = 0% (92274688 bytes), duration 208 sec)

progress 35% (read 12029263872 bytes, zeroes = 0% (92274688 bytes), duration 216 sec)

progress 36% (read 12373196800 bytes, zeroes = 0% (92274688 bytes), duration 224 sec)

progress 37% (read 12717129728 bytes, zeroes = 0% (92274688 bytes), duration 231 sec)

progress 38% (read 13056868352 bytes, zeroes = 0% (109051904 bytes), duration 237 sec)

progress 39% (read 13400801280 bytes, zeroes = 0% (109051904 bytes), duration 246 sec)

progress 40% (read 13744734208 bytes, zeroes = 0% (109051904 bytes), duration 253 sec)

progress 41% (read 14088667136 bytes, zeroes = 0% (109051904 bytes), duration 261 sec)

progress 42% (read 14432600064 bytes, zeroes = 0% (109051904 bytes), duration 267 sec)

progress 43% (read 14776532992 bytes, zeroes = 0% (109051904 bytes), duration 276 sec)

progress 44% (read 15120465920 bytes, zeroes = 0% (130023424 bytes), duration 281 sec)

progress 45% (read 15464398848 bytes, zeroes = 0% (130023424 bytes), duration 287 sec)

progress 46% (read 15808331776 bytes, zeroes = 0% (130023424 bytes), duration 295 sec)

progress 47% (read 16152264704 bytes, zeroes = 0% (130023424 bytes), duration 306 sec)

progress 48% (read 16496197632 bytes, zeroes = 0% (130023424 bytes), duration 316 sec)

restore failed: connection reset

temporary volume 'local:104/vm-104-disk-0.raw' successfully removed

error before or during data restore, some or all disks were not completely restored. VM 104 state is NOT cleaned up.

TASK ERROR: command '/usr/bin/pbs-restore --repository root@pam@192.168.0.91:Backups vm/105/2025-01-06T23:15:58Z drive-scsi0.img.fidx /var/lib/vz/images/104/vm-104-disk-0.raw --verbose --format raw --skip-zero' failed: exit code 255Ich habe auch schon die Netzwerkübertarung verinnert, was aber auch nichts gebracht hat. Kann es sein das beim neuen Server ein storage oder was anderes fehlt? Ich glaube die zwei Backups sind VMś und die anderen sind CT. Hat eventuell einer eine Hilfreiche Idee?