Guten Tag,

ich habe das problem, dass mein server nicht mehr über das lokale und globale Netz erreichbar ist, seitdem ich diesen für eine Problembehebung neugestartet habe.

Das problem: ich habe eine Nextcloud vm, auf der ich zu oft das gleiche update wiederholt heruntergeladen habe (vermutlich) wodurch der ram der vm voll war. Der NC Server konnte nicht mehr in den wartungsmodus umschalten, weshalb ich diesen neustarten wollte (um auch den ram zu "leeren"). Selbst das ging nach mehreren versuchen nicht , Fehlermeldung war folgende:

Dementsprechend habe ich mich entschieden, den gesamten proxmox server neuzustarten, wonach ich über die lokale IP keinen Zugriff mehr hatte

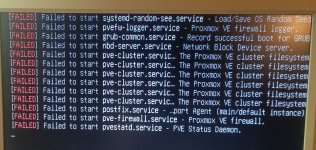

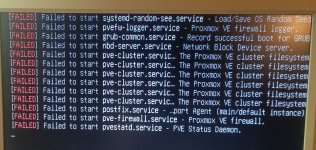

Nach dem anschließen eines monitors am Server habe ich dann folgende fehlermeldungen beim Neustart zu Gesicht bekommen:

Was kann/soll ich machen, um den server wieder auf standardbetrieb zu kriegen. Die lokale Konsole scheint normal zu funktionieren.

Würde es helfen, den server einmal komplett vom strom zu nehmen?

Dass die nextcloud Daten erhalten bleiben wäre bevorzugt und angeblich hat der auch wie normal beim updater ein angebliches backup erstellt.

Konstruktive Hilfe ist gewünscht, bei Fragen zu details o. Ä. Antworte ich liebendgerne innerhalb dieses threads

ich habe das problem, dass mein server nicht mehr über das lokale und globale Netz erreichbar ist, seitdem ich diesen für eine Problembehebung neugestartet habe.

Das problem: ich habe eine Nextcloud vm, auf der ich zu oft das gleiche update wiederholt heruntergeladen habe (vermutlich) wodurch der ram der vm voll war. Der NC Server konnte nicht mehr in den wartungsmodus umschalten, weshalb ich diesen neustarten wollte (um auch den ram zu "leeren"). Selbst das ging nach mehreren versuchen nicht , Fehlermeldung war folgende:

starting worker failed: unable to create file '/var/log/pve/tasks/A/UPID:pve:0029F66A:028249B6:69A52A7A:qmstop:101:root@pam:' - No space left on device (500)Dementsprechend habe ich mich entschieden, den gesamten proxmox server neuzustarten, wonach ich über die lokale IP keinen Zugriff mehr hatte

Nach dem anschließen eines monitors am Server habe ich dann folgende fehlermeldungen beim Neustart zu Gesicht bekommen:

Was kann/soll ich machen, um den server wieder auf standardbetrieb zu kriegen. Die lokale Konsole scheint normal zu funktionieren.

Würde es helfen, den server einmal komplett vom strom zu nehmen?

Dass die nextcloud Daten erhalten bleiben wäre bevorzugt und angeblich hat der auch wie normal beim updater ein angebliches backup erstellt.

Konstruktive Hilfe ist gewünscht, bei Fragen zu details o. Ä. Antworte ich liebendgerne innerhalb dieses threads

Last edited: