Migration der Mount Points von LXC-NFS-Container in VM

- Thread starter maze-m

- Start date

You are using an out of date browser. It may not display this or other websites correctly.

You should upgrade or use an alternative browser.

You should upgrade or use an alternative browser.

Jein. Technisch möglich, ist aber gefährlich und umständlich und die Schritte kommen auf den Speicher an. Für LVM funktioniert das

Was hier, bzw. generell, funktioniert

Du kannst natürlich auch einfach

Das ist ein langer Text den ich ab und an mal wieder editiere, bitte also nicht komplett zitieren!

- Detache die Platte(n) in

Resourcesbeim CT und fahre ihn herunter - Benenne sie um via

lvrename /dev/Datengrab/vm-100-disk-1 /dev/pve/vm-IDDERVMHIER-disk-XXX qm rescandamit PVE die Festplatte wegen der ID bzw. dem Namen nun der VM zuweist- Unbenutze Festplatte in

Hardwareattachen - Innerhalb der VM mounten und spaß haben

subvol lässt mich hier darauf deuten) ist, dass CTs ein Dataset nutzen und VMs ein ZVOLs. Du musst also etwas anders arbeiten.Was hier, bzw. generell, funktioniert

- Verschiebe die Platte(n) auf ein

Directorystorage - Detache die Platte(n) in

Resourcesbeim CT und fahre ihn herunter - Hol dir den Pfad via

pvesm path local:100/vm-100-disk-0.raw - Benenne sie um via

mv /var/lib/vz/images/100/vm-100-disk-0.raw /var/lib/vz/images/IDDERVMHIER/vm-IDDERVMHIER-disk-XXX.raw

/var/lib/vz/images/IDDERVMHIER/muss vermutlich noch viamkdirerstellt werden. qm rescandamit PVE die Festplatte wegen der ID bzw. dem Namen nun der VM zuweist- Via

Disk Action > Move Storagekann sie nun wieder zu ZFS migriert werden, - Unbenutze Festplatte in

Hardwareattachen - Innerhalb der VM mounten und spaß haben

Du kannst natürlich auch einfach

rsync oder so nutzen um die Daten live zu synchronisieren. Das wäre meine Wahl denn obiges finde ich doof. Zudem präferiere ich mein Dateisystem auf einer Partition.Das ist ein langer Text den ich ab und an mal wieder editiere, bitte also nicht komplett zitieren!

Last edited:

Vielen lieben Dank dir für die sehr ausführliche Erklärung und ich denke, dass ein 'rsync -phaxPHAX' <QUELLE_ALTER_LXC_CONTAINER> <ZIEL_NEUE_VM>' wahrscheinlich das Einfachste und Schnellste wäre ...Du kannst natürlich auch einfachrsyncoder so nutzen um die Daten live zu synchronisieren. Das wäre meine Wahl denn obiges finde ich doof. Zudem präferiere ich mein Dateisystem auf einer Partition.

Manchmal sieht man den Wald vor lauter Bäumen nicht .

Aber was meinst du mit "...präferiere ich mein Dateisystem auf einer Partition"?

Wenn man die CT Festplatte wie oben erklärt zu einer VM Festplatte konvertiert wäre das Dateisystem direkt auf der Platte.

/dev/sdb zB. Ich mag das aus bestimmten Gründen lieber auf einer Partition wie zB /dev/sdb1. Hier gibt es ein paar: https://unix.stackexchange.com/questions/14010/the-merits-of-a-partitionless-filesystem@Impact nochmal hierzu ein FrageDie alte Referenz des CTs muss dann auch noch aufgeräumt werden. Möglicherwise habe ich eine simplere Option aber auch übersehen.

Du kannst natürlich auch einfachrsyncoder so nutzen um die Daten live zu synchronisieren. Das wäre meine Wahl denn obiges finde ich doof. Zudem präferiere ich mein Dateisystem auf einer Partition.

Das ist ein langer Text den ich ab und an mal wieder editiere, bitte also nicht komplett zitieren!

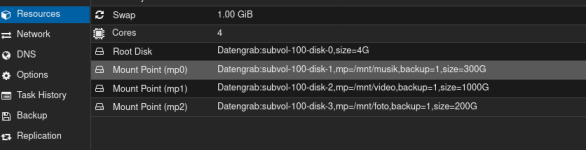

Ich hab mir jetzt eine neue Debian-VM erstellt, welche ich gerne als neuen NFS-Server laufen lassen will...

Ich hab ja die drei Mount Points, für welche ich mir jeweils eine separate Festplatten an die neu erstellte Debian-VM erstellen würde:

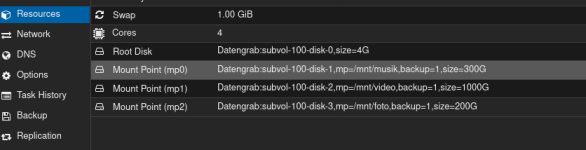

Wenn ich mir nun allerdings in der Debian-VM eine Festplatte mit 1000GiB im ZFS-Pool 'Datengrab' erstelle, bekomme ich die Meldung:

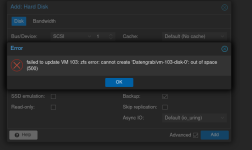

Allerdings sind im ZFS-Pool noch 1,78TB frei:

Habe ich eine Denkfehler, oder warum kann ich keine so große Festplatte für die VM erstellen?

Teile mal bitte

Hier wird erklärt wie man Thin Provisioning richtig konfiguriert and auch wie man das behebt: https://gist.github.com/Impact123/3dbd7e0ddaf47c5539708a9cbcaab9e3#discard

zfs list -ospace,refreservation. Ich nehme an, dass Thin Provisioning nicht aktiviert ist.Hier wird erklärt wie man Thin Provisioning richtig konfiguriert and auch wie man das behebt: https://gist.github.com/Impact123/3dbd7e0ddaf47c5539708a9cbcaab9e3#discard

Last edited:

EinTeile mal bittezfs list -ospace,refreservation. Ich nehme an, dass Thin Provisioning nicht aktiviert ist.

Hier wird erklärt wie man Thin Provisioning richtig konfiguriert and auch wie man das behebt: https://gist.github.com/Impact123/3dbd7e0ddaf47c5539708a9cbcaab9e3#discard

zfs list -ospace,refreservation liefert das zurück:

Bash:

root@pve:~# zfs list -ospace,refreservation

NAME AVAIL USED USEDSNAP USEDDS USEDREFRESERV USEDCHILD REFRESERV

Datengrab 1.07T 1.23T 0B 186K 0B 1.23T none

Datengrab/subvol-100-disk-0 3.38G 635M 0B 635M 0B 0B none

Datengrab/subvol-100-disk-1 70.2G 230G 0B 230G 0B 0B none

Datengrab/subvol-100-disk-2 104G 896G 0B 896G 0B 0B none

Datengrab/subvol-100-disk-3 176G 23.9G 0B 23.9G 0B 0B none

Datengrab/subvol-101-disk-1 10.8G 5.23G 0B 5.23G 0B 0B none

Datengrab/subvol-104-disk-0 35.3G 64.7G 0B 64.7G 0B 0B none

Datengrab/vm-102-disk-0 1.10T 35.4G 0B 7.28G 28.1G 0B 35.4G

rpool 174G 4.99G 0B 208K 0B 4.99G none

rpool/ROOT 174G 2.94G 0B 192K 0B 2.94G none

rpool/ROOT/pve-1 174G 2.94G 0B 2.94G 0B 0B none

rpool/data 174G 1.28G 0B 192K 0B 1.28G none

rpool/data/vm-103-disk-0 174G 1.28G 0B 1.28G 0B 0B none

rpool/var-lib-vz 174G 778M 0B 778M 0B 0B none

root@pve:~#Klar, sehr gerne:

Bash:

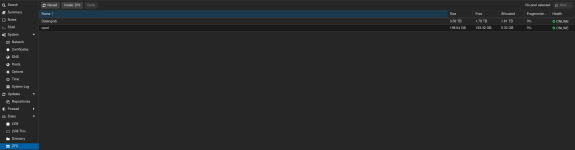

root@pve:~# cat /etc/pve/storage.cfg

dir: local

path /var/lib/vz

content backup,vztmpl,iso

zfspool: local-zfs

pool rpool/data

content rootdir,images

sparse 1

zfspool: Datengrab

pool Datengrab

content rootdir,images

mountpoint /Datengrab

nodes pve

root@pve:~#Vielen lieben Dank dir für den super Support!

Dann schau ich mal, dass ich Thin Provisioning vergebe. Ich würde es mir hier aus deinem Link dann mal durchlesen und bei Fragen nochmal schreiben .

.

Dann schau ich mal, dass ich Thin Provisioning vergebe. Ich würde es mir hier aus deinem Link dann mal durchlesen und bei Fragen nochmal schreiben