Latest activity

-

mir replied to the thread Upgrading to pve-9.1: apparmor.service.It seems the problem is a lxc container with a mount point which is causing the problems. Attached is the debug log from starting the container like this: lxc-start -n 103 -F -lDEBUG -o /tmp/103.log

mir replied to the thread Upgrading to pve-9.1: apparmor.service.It seems the problem is a lxc container with a mount point which is causing the problems. Attached is the debug log from starting the container like this: lxc-start -n 103 -F -lDEBUG -o /tmp/103.log -

Ttorroe posted the thread PBS Bug: datastore s3-refresh panics (entered unreachable code) in Proxmox Backup: Installation and configuration.On Proxmox Backup Server with an S3-backed datastore, the command proxmox-backup-manager datastore s3-refresh <store> consistently crashes with a Rust panic: thread 'main' panicked at src/bin/proxmox_backup_manager/datastore.rs:343:14: internal...

-

Eexp replied to the thread [SOLVED] Replication with different target storage name.Nearly ten years. Wow! I just asked this (https://forum.proxmox.com/threads/zfs-replication-with-two-nodes-and-different-pool-names.178638/#post-828572) and can't believe this is true and more so after all of these reports and ten years. First...

-

Jjayjayjay replied to the thread [SOLVED] Issue booting into GRUB after upgrade from Proxmox 8 to 9.Hello, I have the same issue and the fix proposed by @Carizoeuf partially solved my issue: I don't have the grub prompt but I am able to boot on proxmox by using the "rescue boot" via the installation iso Then I pass both command...

-

Eexp replied to the thread ZFS replication with two nodes and different pool names.Wow, that's insane. Thank you!

-

Iigregor replied to the thread pvestatd segfaults.Same here, one of MS-01 gets segfault on pvestatd. This one had a newer experimental kernel installed, and now on default 6.8.12-17 kernel from proxmox 8.4.16. All units on same kernel.

-

Bbluesite replied to the thread Script zum zeitgesteuerten runterfahren funktioniert nur im Direktaufruf fehlerfrei *gelöst*.nimm doch einfach ein hook-script da kannst Du sagen das er wenn das Backup zu Ende ist er den Rechner runterfahren soll #!/bin/bash #set -e; #set -x; # fstrim vor backup if [ "$1" == 'pre-start' ]; then /usr/sbin/qm guest exec "$3" --...

-

Cchaqueline06 replied to the thread Disable IPv6 within LCX container.I had success with disabling ipv6 in LXC (tried with ubuntu 24) with this script.

-

LLucasKer replied to the thread Fragen als Newcomer.Ich kenne mich aus sonst würde ich es nicht anbieten. Ich hab mit proxmox noch nie gearbeitet und jede anwendung ist da anderst. ich arbeite mich derzeit ein und versuche proxmox kennen zu lernen bevor ich da irgendwie meine systeme migriere...

-

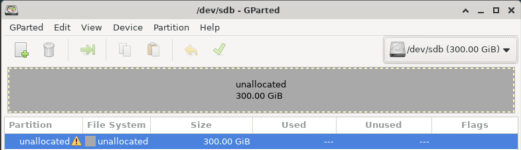

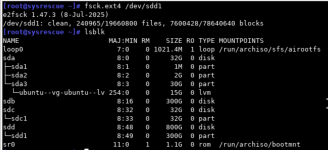

Ggctwnl replied to the thread [SOLVED] Accidentally increased size of a disk for a client. How do I decrease?.In addition: might I not have to change /etc/pve# cat /etc/pve/qemu-server/100.conf? It seems to hold config data for my VM and the lvresize of course hasn't updated this. When I increased the size of an LV via the GUI, it was of course updated...

-

MMelbourneNerd53 reacted to SInisterPisces's post in the thread Use Cases for S3 Integration in Early 2026? with

Like.

Hello, Now that PBS' S3 support has been around for a while and people have been using it (and the dev team has been putting so much effort into continuously refining it), I'm curious: for someone who's new to S3-based storage solutions, when is...

Like.

Hello, Now that PBS' S3 support has been around for a while and people have been using it (and the dev team has been putting so much effort into continuously refining it), I'm curious: for someone who's new to S3-based storage solutions, when is... -

MMelbourneNerd53 reacted to kaliszad's post in the thread Proxmox Backup Server 4.1 released! with

Like.

A customer just reported a more than 3x speedup in their setup.

Like.

A customer just reported a more than 3x speedup in their setup. -

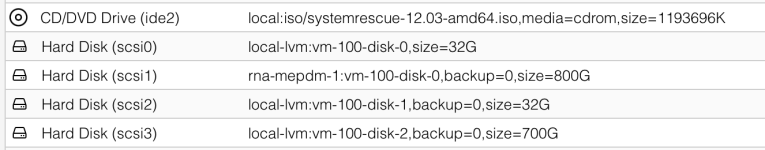

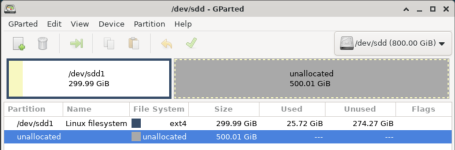

Ggctwnl replied to the thread [SOLVED] Accidentally increased size of a disk for a client. How do I decrease?.Hmm, that wasn't the case. It was still reported 800G and another one was 300G. Eek! Something went horribly wrong? SystemRescue now says /dev/sdd1 is 299.99GiB of which 25.72 GiB is used (that is correct after having resized it with Gparted...

-

Ssilverstone replied to the thread After reboot no webgui and pve-cluster.service fail.Old Thread but I'll add my 0.02$ just in case you are still looking for a Solution. In my Case, this can happen (mostly on a Backup Server) if I sent there a ZFS Snapshot WITHOUT specifying a -o mountpoint=/zdata/BACKUP/<HOST> Parameter when...

-

SSpennorex replied to the thread PVE 9.1.1-9.1.4 and RockyOS10 LXC container not respecting .pve-ignore.resolv.conf file.I tried some more with a friend, checked if IP settings are set to DHCP at all, they're both on static, and only IPv4 is configured, and using a single interface. The specific RockyLinux 10 template i use is...

-

UdoB replied to the thread Proxmox Backupserver ?.Ohne einen PBS machst du "vzdump"-basierte Backups, richtig? Jedes Backup ist ein Vollbackup und belegt jeweils (in etwa) den gleichen Platz, richtig? Mit PBS macht man ebenfalls jedesmal "logisch" ein Vollbackup, es werden aber nur neue...

UdoB replied to the thread Proxmox Backupserver ?.Ohne einen PBS machst du "vzdump"-basierte Backups, richtig? Jedes Backup ist ein Vollbackup und belegt jeweils (in etwa) den gleichen Platz, richtig? Mit PBS macht man ebenfalls jedesmal "logisch" ein Vollbackup, es werden aber nur neue... -

DDeuSimon replied to the thread Proxmox Backupserver ?.Es kommt auch darauf an, wie groß die VZDumps und wie oft du Backups macht. Ich habe auf meiner "alten" Synology 923+ PBS in einer VM installiert. NFS. Da ich halt sehr viel ausgemountet habe, also zB die Dokumente für Paperless speichere ich...

-

WWith the way things have been going, we won't see ZFS 2.4 integration until proxmox v10...