Moin,

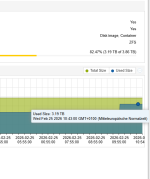

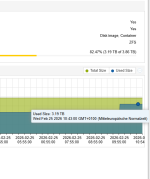

wir replizieren aktuell eine Windows VM mit einer Platte (880G) auf eine zweite Node. Ohne Replikation zeigt der Storage ~60% an, nach der Replikation scheint die gesamte Festplatte nochmal auf dem ZFS01/Node1 aufgerechnet zu werden. Aus 880G werden ~1760G

Nach meiner Auffassung sollte eine Replikation inkrementell stattfinden und nicht die Platte für die Replikation kopieren - Kann es sein dass es sich hier um einen Anzeigefehler handelt?

Beide Cluster Member haben einen Storage (ZFS01) Und wir hatten in der Vergangenheit schon komische Konstellationen wo wir auf einem Rechner ein ZFS gelöscht haben (per CLI) und dann diese auf ALLEN Nodes im Cluster fehlten. (Glücklicherweise war nur die Anzeige falsch)

Übersicht nach UI Summary:

Das ist die angefangene Replikation:

Kann da jemand etwas Licht ins dunkle bringen?

Gruß

Niklas

wir replizieren aktuell eine Windows VM mit einer Platte (880G) auf eine zweite Node. Ohne Replikation zeigt der Storage ~60% an, nach der Replikation scheint die gesamte Festplatte nochmal auf dem ZFS01/Node1 aufgerechnet zu werden. Aus 880G werden ~1760G

Nach meiner Auffassung sollte eine Replikation inkrementell stattfinden und nicht die Platte für die Replikation kopieren - Kann es sein dass es sich hier um einen Anzeigefehler handelt?

Beide Cluster Member haben einen Storage (ZFS01) Und wir hatten in der Vergangenheit schon komische Konstellationen wo wir auf einem Rechner ein ZFS gelöscht haben (per CLI) und dann diese auf ALLEN Nodes im Cluster fehlten. (Glücklicherweise war nur die Anzeige falsch)

zfpool list

Code:

NAME SIZE ALLOC FREE CKPOINT EXPANDSZ FRAG CAP DEDUP HEALTH ALTROOT

ZFS01 3.62T 1.22T 2.41T - - 1% 33% 1.00x ONLINE -Übersicht nach UI Summary:

Das ist die angefangene Replikation:

Kann da jemand etwas Licht ins dunkle bringen?

Gruß

Niklas