Hallo,

meine Windows 11 VM auf der 2 Datenbanken laufen ist recht träge.

Kurze Vorgeschichte: Bis letztes Jahr hatte ich meinen Proxmox auf Consumer Hardware laufen (Intel i9 12600k, 128 GB Ram, Samsung Prosumer SSD). Einige Container und VMs drauf. Es lief soweit gut bis auf eine Windows 11 VM auf der 2 Datenbanken laufen (ecoDMS als Dokumentenmanagement und ein Lexware Server für Buchhaltung etc.). Hier war das Lexware immer sehr lansam.

Da ich viel über die ungeügende Leistung von Consumer SSD gelesen habe habe ich nun auf "richtige" Serverhardware gewechselt.

Hier die Eckdaten zum System:

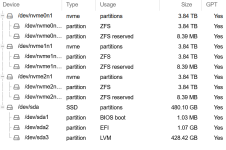

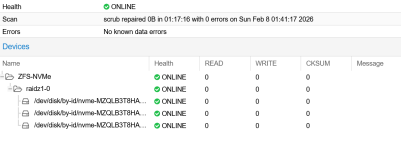

Lenovo ThinkSystem SR630 V3, 1x Xeon Gold 6526Y, 128 GB Ram, 9350-8i Controller, 3x PM983 3,84TB NVMe plus eine SM 863 SSD für das Hostsystem. Die Festplatten habe ich ohne Hardwareraid als ZFS eingerichtet.

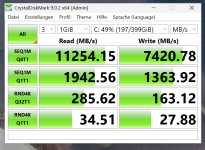

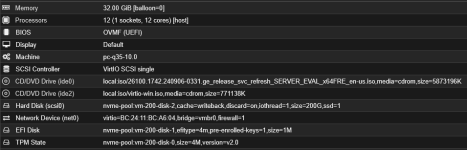

Voller Vorfreude habe ich alle VMs umgezogen. Die Linux VMs und Container laufen nach wie vor sehr gut und da kann ich keinen Unterschied merken. Leider kann ich auch beim Windows 11 Server keinen Unterschied feststellen. Das Lexware läuft auch auf der neuen Hardware sehr träge. Mit den CPU Einstellungen habe ich schon einiges probiert und gelernt dass die Einstellung "Host" für W11 nicht gut ist sondern "MAX" oder "x86-64-v4" auszuwählen ist. Jetzt habe ich mal die Festplattengeschwindigkeit mit Cristaldiskmak getestet und mir scheint die 4K Leistung sehr schlecht zu sein (Siehe Anhang).

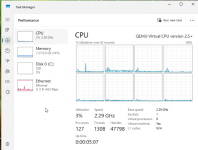

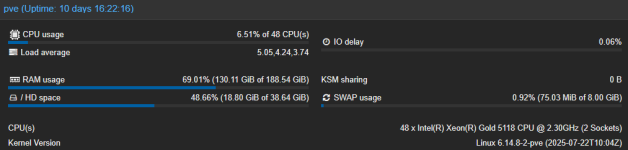

Hat jemand von Euch eine Idee woran das liegen kann? Die CPU Last des Proxmox liegt bei unter 10% und das IO delay im 0,0X% Bereich. Muss ich dam am Controller noch was umstellen?

Gruß Jochen

meine Windows 11 VM auf der 2 Datenbanken laufen ist recht träge.

Kurze Vorgeschichte: Bis letztes Jahr hatte ich meinen Proxmox auf Consumer Hardware laufen (Intel i9 12600k, 128 GB Ram, Samsung Prosumer SSD). Einige Container und VMs drauf. Es lief soweit gut bis auf eine Windows 11 VM auf der 2 Datenbanken laufen (ecoDMS als Dokumentenmanagement und ein Lexware Server für Buchhaltung etc.). Hier war das Lexware immer sehr lansam.

Da ich viel über die ungeügende Leistung von Consumer SSD gelesen habe habe ich nun auf "richtige" Serverhardware gewechselt.

Hier die Eckdaten zum System:

Lenovo ThinkSystem SR630 V3, 1x Xeon Gold 6526Y, 128 GB Ram, 9350-8i Controller, 3x PM983 3,84TB NVMe plus eine SM 863 SSD für das Hostsystem. Die Festplatten habe ich ohne Hardwareraid als ZFS eingerichtet.

Voller Vorfreude habe ich alle VMs umgezogen. Die Linux VMs und Container laufen nach wie vor sehr gut und da kann ich keinen Unterschied merken. Leider kann ich auch beim Windows 11 Server keinen Unterschied feststellen. Das Lexware läuft auch auf der neuen Hardware sehr träge. Mit den CPU Einstellungen habe ich schon einiges probiert und gelernt dass die Einstellung "Host" für W11 nicht gut ist sondern "MAX" oder "x86-64-v4" auszuwählen ist. Jetzt habe ich mal die Festplattengeschwindigkeit mit Cristaldiskmak getestet und mir scheint die 4K Leistung sehr schlecht zu sein (Siehe Anhang).

Hat jemand von Euch eine Idee woran das liegen kann? Die CPU Last des Proxmox liegt bei unter 10% und das IO delay im 0,0X% Bereich. Muss ich dam am Controller noch was umstellen?

Gruß Jochen