Hallo zusammen,

seit dem Wochenende beschäftige ich mich mit einem HA Cluster, Proxmox selbst nutze ich seit Jahren.

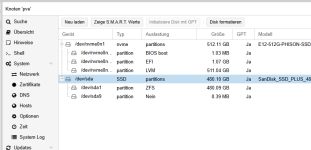

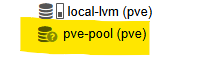

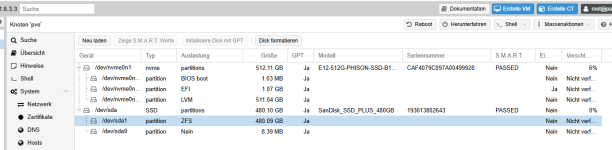

Durch einige Anleitungen habe ich ein Cluster mit einem ZFS Laufwerk/Pool erstellt.

Mittlerweile aber herausgefunden das ich eher auf Ceph wechseln sollte.

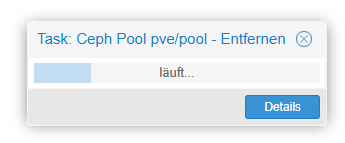

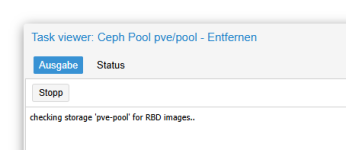

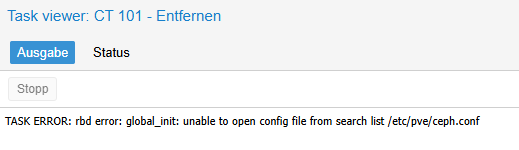

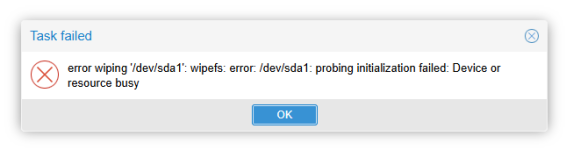

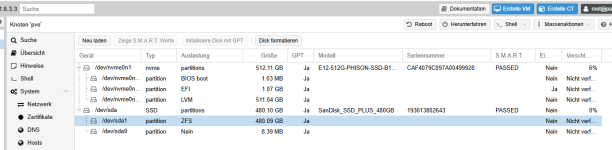

Problem ist jetzt das ich meine ZFS SSD nicht mehr löschen kann.

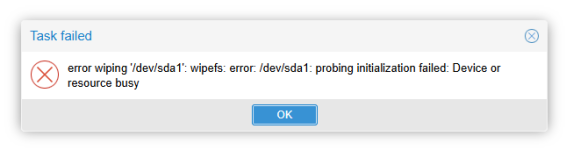

Sobald ich sie formatieren möchte kommt eine Fehlermeldung.

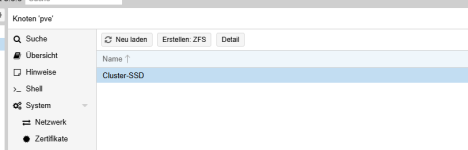

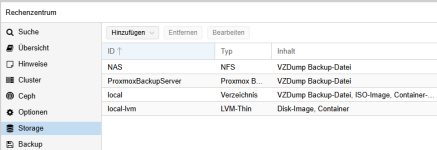

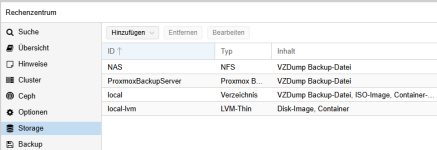

HA ist noch nicht eingerichtet und im Rechenzentrum ist es auch kein Pool mehr.

Auf der SSD sind keine VM's, CT..., komplett leer

Wie kann ich die SSD in pve wieder komplett formatieren und neu zur Verfügung stellen?

seit dem Wochenende beschäftige ich mich mit einem HA Cluster, Proxmox selbst nutze ich seit Jahren.

Durch einige Anleitungen habe ich ein Cluster mit einem ZFS Laufwerk/Pool erstellt.

Mittlerweile aber herausgefunden das ich eher auf Ceph wechseln sollte.

Problem ist jetzt das ich meine ZFS SSD nicht mehr löschen kann.

Sobald ich sie formatieren möchte kommt eine Fehlermeldung.

HA ist noch nicht eingerichtet und im Rechenzentrum ist es auch kein Pool mehr.

Auf der SSD sind keine VM's, CT..., komplett leer

Wie kann ich die SSD in pve wieder komplett formatieren und neu zur Verfügung stellen?