Hallo zusammen,

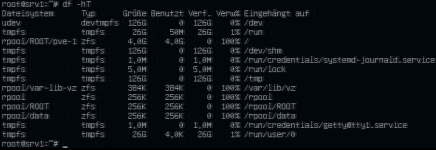

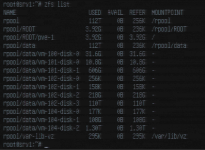

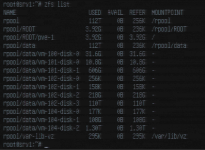

ich stehe hier gerade vor einem kleinen Problem bei unserem Proxmox Server. Bei der Einrichtung wurde ein großes ZFS (insgesamt 15 HDDs á 10 TB) gespannt. Anfang der Woche ist eine Festplatte ausgefallen und wurde ausgetauscht, zu dem Zeitpunkt bestand allerdings schon kein Zugriff mehr auf den Server. Nach dem Austausch ist das Resilvering durchlaufen lassen, es besteht weiterhin kein Zugriff und es wird der komplette Speicher als voll angezeigt:

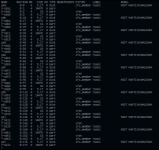

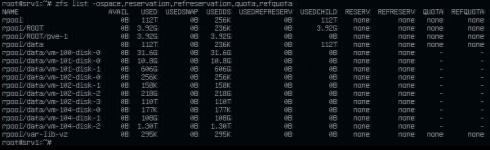

Snapshots sind keine vorhanden, die Speicherplatz belegen könnten. Logdateien sind auch alle schon gekürzt. Discard ist bei den VM-Disks leider nicht aktiviert.

Die Dienste starten aufgrund des nicht vorhandenen Speicherplatzes nicht, Zugriff über SSH besteht derzeit leider auch nicht, deswegen bin ich auf eine KVM vom Rechenzentrum angewiesen.

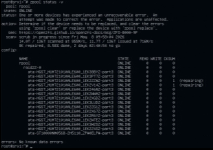

In meiner Verzweifelung habe ich auch schon in der /sys/module/zfs/parameters/spa_slop_shift den Wert von 5 auf 6 geändert, aber siehe Ausgabe oben. Der Screenshot entstand nach der Ausführung des Befehls (und einem Reboot weil zuerst keine Änderung ersichtlich war).

Habt ihr noch Tipps für mich, wie ich nun am besten vorgehen kann? Respektive, was braucht ihr noch für weitere Informationen um eventuell Tipps geben zu können?

Viele Dank im Voraus schonmal!

ich stehe hier gerade vor einem kleinen Problem bei unserem Proxmox Server. Bei der Einrichtung wurde ein großes ZFS (insgesamt 15 HDDs á 10 TB) gespannt. Anfang der Woche ist eine Festplatte ausgefallen und wurde ausgetauscht, zu dem Zeitpunkt bestand allerdings schon kein Zugriff mehr auf den Server. Nach dem Austausch ist das Resilvering durchlaufen lassen, es besteht weiterhin kein Zugriff und es wird der komplette Speicher als voll angezeigt:

Snapshots sind keine vorhanden, die Speicherplatz belegen könnten. Logdateien sind auch alle schon gekürzt. Discard ist bei den VM-Disks leider nicht aktiviert.

Die Dienste starten aufgrund des nicht vorhandenen Speicherplatzes nicht, Zugriff über SSH besteht derzeit leider auch nicht, deswegen bin ich auf eine KVM vom Rechenzentrum angewiesen.

In meiner Verzweifelung habe ich auch schon in der /sys/module/zfs/parameters/spa_slop_shift den Wert von 5 auf 6 geändert, aber siehe Ausgabe oben. Der Screenshot entstand nach der Ausführung des Befehls (und einem Reboot weil zuerst keine Änderung ersichtlich war).

Habt ihr noch Tipps für mich, wie ich nun am besten vorgehen kann? Respektive, was braucht ihr noch für weitere Informationen um eventuell Tipps geben zu können?

Viele Dank im Voraus schonmal!