Guten Abend,

ich habe hier ein merkwürdiges Problem wo ich irgendwie keine Lösung finde und auch nicht verstehe wieso das so ist. Eventuell kann mir jemand weiter helfen.

Folgende Ausgangslage:

- Proxmox ist auf 2x 4TB im Mirror (Samsung PM9A3 U.2 - per SlimSAS angeschlossen). Hier laufen die VMs auch drauf.

- ein Supermicro JBOD ist separat verbaut wo 8x18TB+4x12TB HDD (Toshiba Datacenter HDDs), 2x 480GB SSD (Intel S4610), 3x 960GB SSD (Intel S4610) drin stecken. Diese sind per SAS3 Backplane an eine 9400-16e angebunden.

- alle Festplatten laufen in diversen ZFS Pools.

-auf einer VM laufen Downloads (hier ist noch eine separate M.2 PCI verbaut, mit 4TB) mit ca 120MB/s, diese werden nach Fertigstellung entpackt. Dies läuft alles auf der M.2 wegen dem Write und Read Speed. Danach werden die entdeckten Medien auf einen ZFS Pool verschoben (8x18TB).

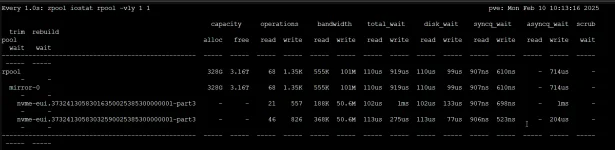

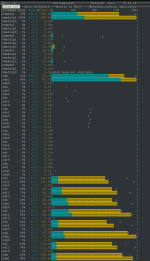

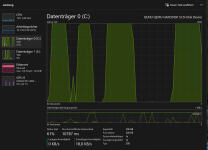

Jetzt habe ich das Problem, sobald diese Konstellation läuft mit Fullspeed Download, entpacken und verschieben, das die Systemplatten einiger VMs (das sind die U.2, die nicht mit den anderen angeschlossen sind), massive Auslastung (100%) haben und teils sekundenlang nicht reagieren.

Hat jemand eine Idee wieso diese Aussetzer da sind, obwohl von den oberen Vorgängen auf der U.2 nichts passiert?

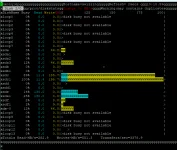

Hier zpool list:

ich habe hier ein merkwürdiges Problem wo ich irgendwie keine Lösung finde und auch nicht verstehe wieso das so ist. Eventuell kann mir jemand weiter helfen.

Folgende Ausgangslage:

- Proxmox ist auf 2x 4TB im Mirror (Samsung PM9A3 U.2 - per SlimSAS angeschlossen). Hier laufen die VMs auch drauf.

- ein Supermicro JBOD ist separat verbaut wo 8x18TB+4x12TB HDD (Toshiba Datacenter HDDs), 2x 480GB SSD (Intel S4610), 3x 960GB SSD (Intel S4610) drin stecken. Diese sind per SAS3 Backplane an eine 9400-16e angebunden.

- alle Festplatten laufen in diversen ZFS Pools.

-auf einer VM laufen Downloads (hier ist noch eine separate M.2 PCI verbaut, mit 4TB) mit ca 120MB/s, diese werden nach Fertigstellung entpackt. Dies läuft alles auf der M.2 wegen dem Write und Read Speed. Danach werden die entdeckten Medien auf einen ZFS Pool verschoben (8x18TB).

Jetzt habe ich das Problem, sobald diese Konstellation läuft mit Fullspeed Download, entpacken und verschieben, das die Systemplatten einiger VMs (das sind die U.2, die nicht mit den anderen angeschlossen sind), massive Auslastung (100%) haben und teils sekundenlang nicht reagieren.

Hat jemand eine Idee wieso diese Aussetzer da sind, obwohl von den oberen Vorgängen auf der U.2 nichts passiert?

Hier zpool list:

NAME SIZE ALLOC FREE CKPOINT EXPANDSZ FRAG CAP DEDUP HEALTH ALTROOT

Download-nvme 3.62T 530G 3.11T - - 0% 14% 1.00x ONLINE -

nvme-Samsung_SSD_990_PRO_with_Heatsink_4TB_S7DSNJ0WC00577J_1 3.64T 530G 3.11T - - 0% 14.3% - ONLINE

Downloads 888G 134G 754G - - 1% 15% 1.00x ONLINE -

ata-SSDSC2KG960G8L_01PE338D7A09686LEN_PHYG829301UV960CGN 894G 134G 754G - - 1% 15.1% - ONLINE

Firewall 444G 31.7G 412G - - 7% 7% 1.00x ONLINE -

mirror-0 444G 31.7G 412G - - 7% 7.14% - ONLINE

ata-INTEL_SSDSC2KG480G8_BTYG941600PU480BGN 447G - - - - - - - ONLINE

ata-INTEL_SSDSC2KG480G8_BTYG941601YE480BGN 447G - - - - - - - ONLINE

Kamera 10.9T 8.44T 2.46T - - 25% 77% 1.00x ONLINE -

mirror-0 10.9T 8.44T 2.46T - - 25% 77.4% - ONLINE

ata-TOSHIBA_MG07ACA12TE_33W0A0C6F95G 10.9T - - - - - - - ONLINE

ata-TOSHIBA_MG07ACA12TE_33W0A0D6F95G 10.9T - - - - - - - ONLINE

PBS 3.48T 2.45T 1.04T - - 2% 70% 1.00x ONLINE -

mirror-0 3.48T 2.45T 1.04T - - 2% 70.2% - ONLINE

nvme-eui.36344830529003640025384500000001 3.49T - - - - - - - ONLINE

nvme-eui.36344830528006630025384500000001 3.49T - - - - - - - ONLINE

P. 132T 26.1T 106T - - 0% 19% 1.00x ONLINE -

raidz1-0 65.5T 13.1T 52.4T - - 0% 19.9% - ONLINE

wwn-0x5000039b28d2cba1 16.4T - - - - - - - ONLINE

ata-TOSHIBA_MG09ACA18TE_53U0A0B3FJDH 16.4T - - - - - - - ONLINE

ata-TOSHIBA_MG09ACA18TE_71H0A08UFQDH 16.4T - - - - - - - ONLINE

ata-TOSHIBA_MG09ACA18TE_71F0A1KYFQDH 16.4T - - - - - - - ONLINE

raidz1-1 65.5T 13.0T 52.4T - - 0% 19.9% - ONLINE

ata-TOSHIBA_MG09ACA18TE_91J0A09GFJDH 16.4T - - - - - - - ONLINE

ata-TOSHIBA_MG09ACA18TE_71F0A1JJFQDH 16.4T - - - - - - - ONLINE

ata-TOSHIBA_MG09ACA18TE_71H0A08TFQDH 16.4T - - - - - - - ONLINE

ata-TOSHIBA_MG09ACA18TE_53F0A2PJFJDH 16.4T - - - - - - - ONLINE

special - - - - - - - - -

mirror-2 888G 14.2G 874G - - 8% 1.59% - ONLINE

wwn-0x55cd2e414f9dd978 894G - - - - - - - ONLINE

wwn-0x55cd2e414f9de042 894G - - - - - - - ONLINE

Tdarr 232G 28.8G 203G - - 0% 12% 1.00x ONLINE -

ata-CT250MX500SSD1_2152E5F7B391 233G 28.8G 203G - - 0% 12.4% - ONLINE

VX 10.9T 39.8G 10.9T - - 1% 0% 1.00x ONLINE -

mirror-0 10.9T 39.8G 10.9T - - 1% 0.35% - ONLINE

ata-TOSHIBA_MG07ACA12TE_51Q0A1TDF95G 10.9T - - - - - - - ONLINE

ata-TOSHIBA_MG07ACA12TE_51Q0A1TBF95G 10.9T - - - - - - - ONLINE

rpool 3.48T 359G 3.13T - - 5% 10% 1.00x ONLINE -

mirror-0 3.48T 359G 3.13T - - 5% 10.1% - ONLINE

nvme-eui.37324130583016350025385300000001-part3 3.49T - - - - - - - ONLINE

nvme-eui.37324130583032590025385300000001-part3 3.49T - - - - - - - ONLINE