Hallo zusammen,

ich versuche aktuell, eine VM (ID 190111) live auf einen anderen Node zu migrieren. Leider bricht der Vorgang direkt zu Beginn ab. Eine Live-Migration (ohne Downtime) ist für diese VM zwingend erforderlich.

Was mich an dem Log sehr irritiert: Die Festplatten werden als `.qcow2` erkannt, aber bei der `disk-2` (TPM) bricht er mit einem LVM-Fehler ab.

Hier ist das Log:

Meine Fragen dazu:

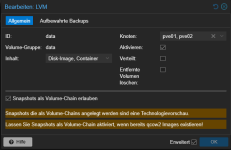

1. Warum wirft Proxmox hier einen LVM-zu-LVM Fehler, obwohl es sich laut Log um `.qcow2` Dateien handelt?

2. Wie kann ich das Problem mit dieser "generated disk" beheben, damit die Live-Migration erfolgreich und ohne Ausfallzeit durchläuft?

bei Disk 2 Handelt es sich um die TPM Partition diese muss ja auch Verschoben werden bei einem Serverausfall..

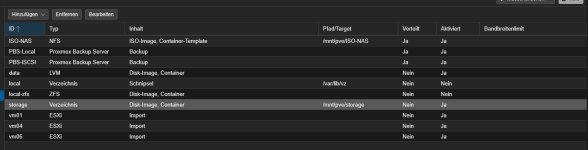

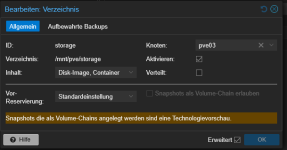

und ein Weiteres Problem ist Offline VMs lassen sich nicht Migireren auf einen Anderen Host wenn dass Ziel Storage ein anderen namen Trägt.

Vielen Dank im Voraus für eure Unterstützung!

ich versuche aktuell, eine VM (ID 190111) live auf einen anderen Node zu migrieren. Leider bricht der Vorgang direkt zu Beginn ab. Eine Live-Migration (ohne Downtime) ist für diese VM zwingend erforderlich.

Was mich an dem Log sehr irritiert: Die Festplatten werden als `.qcow2` erkannt, aber bei der `disk-2` (TPM) bricht er mit einem LVM-Fehler ab.

Hier ist das Log:

Code:

2026-03-24 08:54:40 starting migration of VM 190111 to node 'pve01' (10.10.190.3)

2026-03-24 08:54:40 found local disk 'data:vm-190111-disk-0.qcow2' (attached)

2026-03-24 08:54:40 found local disk 'data:vm-190111-disk-1.qcow2' (attached)

2026-03-24 08:54:40 found generated disk 'data:vm-190111-disk-2.qcow2' (in current VM config)

2026-03-24 08:54:40 copying local disk images

2026-03-24 08:54:40 ERROR: storage migration for 'data:vm-190111-disk-2.qcow2' to storage 'data' failed - cannot migrate from storage type 'lvm' to 'lvm'

2026-03-24 08:54:40 aborting phase 1 - cleanup resources

2026-03-24 08:54:40 ERROR: migration aborted (duration 00:00:01): storage migration for 'data:vm-190111-disk-2.qcow2' to storage 'data' failed - cannot migrate from storage type 'lvm' to 'lvm'

TASK ERROR: migration abortedMeine Fragen dazu:

1. Warum wirft Proxmox hier einen LVM-zu-LVM Fehler, obwohl es sich laut Log um `.qcow2` Dateien handelt?

2. Wie kann ich das Problem mit dieser "generated disk" beheben, damit die Live-Migration erfolgreich und ohne Ausfallzeit durchläuft?

bei Disk 2 Handelt es sich um die TPM Partition diese muss ja auch Verschoben werden bei einem Serverausfall..

und ein Weiteres Problem ist Offline VMs lassen sich nicht Migireren auf einen Anderen Host wenn dass Ziel Storage ein anderen namen Trägt.

Vielen Dank im Voraus für eure Unterstützung!