fstrankowski's latest activity

-

fstrankowski replied to the thread [SOLVED] Configured proxmox as dhcp.Change iface nic0 inet dhcp to iface vmbr0 inet dhcp and then systemctl restart networking P.S.: Still curious about my other question ;-) Found your answer. Awesome! I love fried rice with soy sauce ;-)

fstrankowski replied to the thread [SOLVED] Configured proxmox as dhcp.Change iface nic0 inet dhcp to iface vmbr0 inet dhcp and then systemctl restart networking P.S.: Still curious about my other question ;-) Found your answer. Awesome! I love fried rice with soy sauce ;-) -

fstrankowski replied to the thread [SOLVED] Can't access Web UI after bulk shutdown my whole VM.Welcome to the Proxmox Forum :-) Please connect via https://192.168.2.2:8006. If your PC is running Windows, it will block ICMP requests due to WFW Hit that please (from your macbook): curl -s --insecure https://192.168.2.2:8006 | grep...

fstrankowski replied to the thread [SOLVED] Can't access Web UI after bulk shutdown my whole VM.Welcome to the Proxmox Forum :-) Please connect via https://192.168.2.2:8006. If your PC is running Windows, it will block ICMP requests due to WFW Hit that please (from your macbook): curl -s --insecure https://192.168.2.2:8006 | grep... -

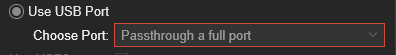

fstrankowski replied to the thread [SOLVED] USB passtrough with 2 identical USB devices.Could you try passing through the whole port (which should be static): That way you dont really need to care about the identical ids.

fstrankowski replied to the thread [SOLVED] USB passtrough with 2 identical USB devices.Could you try passing through the whole port (which should be static): That way you dont really need to care about the identical ids. -

fstrankowski replied to the thread Storage configuration for consumer SSDs (ZFS vs LVM).Which CPU, how much RAM, how many VMs, workload on the VMs, etc. Please provider a bigger picture. By just naming 2 type of drives there is no way to provide a proper answer to your (very broad) question :)

fstrankowski replied to the thread Storage configuration for consumer SSDs (ZFS vs LVM).Which CPU, how much RAM, how many VMs, workload on the VMs, etc. Please provider a bigger picture. By just naming 2 type of drives there is no way to provide a proper answer to your (very broad) question :) -

fstrankowski replied to the thread [SOLVED] Configured proxmox as dhcp.Welcome to the Proxmox Forum :-) Please provide (each result please in a seperate [ CODE ] block) ip a ss -tlpn curl -v ip:8006 (where ip is your dynamic ip) ls /etc/default/pveproxy cat /usr/local/lib/systemd/network/*.link cat /etc/hosts...

fstrankowski replied to the thread [SOLVED] Configured proxmox as dhcp.Welcome to the Proxmox Forum :-) Please provide (each result please in a seperate [ CODE ] block) ip a ss -tlpn curl -v ip:8006 (where ip is your dynamic ip) ls /etc/default/pveproxy cat /usr/local/lib/systemd/network/*.link cat /etc/hosts... -

fstrankowski replied to the thread Wie temporär LXC von einem Knoten auf einen anderen migrieren wenn Knoten unterschiedlich sind?.Wird so passen. Die Systemplatte der VM mit zwei Platten kannst du einfach verschieben. Ohne Cluster und ZFS-Replication würde ich ganz einfach via Backup-Restore die VMs umziehen. Die "Mountpoints" werden wenn du die Platte verschiebst natürlich...

fstrankowski replied to the thread Wie temporär LXC von einem Knoten auf einen anderen migrieren wenn Knoten unterschiedlich sind?.Wird so passen. Die Systemplatte der VM mit zwei Platten kannst du einfach verschieben. Ohne Cluster und ZFS-Replication würde ich ganz einfach via Backup-Restore die VMs umziehen. Die "Mountpoints" werden wenn du die Platte verschiebst natürlich... -

fstrankowski reacted to Falk R.'s post in the thread ProxMox über Webinterface nicht erreichbar (läuft als VM unter Hyper-V) with

fstrankowski reacted to Falk R.'s post in the thread ProxMox über Webinterface nicht erreichbar (läuft als VM unter Hyper-V) with Like.

Der Switch steht auf internes Netzwerk und somit können die VMs nur mit dem HyperV Host kommunizieren. Wenn der virtuelle Switch nach draußen sprechen soll, muss externes Netzwerk und eine Netzwerkkarte ausgewählt werden.

Like.

Der Switch steht auf internes Netzwerk und somit können die VMs nur mit dem HyperV Host kommunizieren. Wenn der virtuelle Switch nach draußen sprechen soll, muss externes Netzwerk und eine Netzwerkkarte ausgewählt werden. -

fstrankowski replied to the thread [SOLVED] Proxmox und VM auf einem Laufwerk?.Da kann ich Dir Storys erzählen, da wird die schwarz vor den Augen. Wir haben vor circa 8 Jahren bereits damit begonnen, alle Raid-Controller zu entsorgen. Wenn überhaupt erlauben wir noch JBOD, alles andere fliegt raus. Grund sind nunmal die...

fstrankowski replied to the thread [SOLVED] Proxmox und VM auf einem Laufwerk?.Da kann ich Dir Storys erzählen, da wird die schwarz vor den Augen. Wir haben vor circa 8 Jahren bereits damit begonnen, alle Raid-Controller zu entsorgen. Wenn überhaupt erlauben wir noch JBOD, alles andere fliegt raus. Grund sind nunmal die... -

fstrankowski reacted to proxuser77's post in the thread [SOLVED] Proxmox und VM auf einem Laufwerk? with

fstrankowski reacted to proxuser77's post in the thread [SOLVED] Proxmox und VM auf einem Laufwerk? with Like.

Das war mal in den 90ern so ;) Ernsthaft, Ein MegaRaid ist ja am Ende auch nur ein Software Raid, mit dem Unterschied, dass es von der Firmware einer properitären Broadcom Karte kontrolliert wird, und wenn dir die abraucht, kann es dir das Raid...

Like.

Das war mal in den 90ern so ;) Ernsthaft, Ein MegaRaid ist ja am Ende auch nur ein Software Raid, mit dem Unterschied, dass es von der Firmware einer properitären Broadcom Karte kontrolliert wird, und wenn dir die abraucht, kann es dir das Raid... -

fstrankowski replied to the thread [SOLVED] Proxmox und VM auf einem Laufwerk?.Das Frage ich mich auch ;-)

fstrankowski replied to the thread [SOLVED] Proxmox und VM auf einem Laufwerk?.Das Frage ich mich auch ;-) -

fstrankowski replied to the thread [SOLVED] Proxmox und VM auf einem Laufwerk?./dev/sda ist bei Dir ein Raid über die MR Karte? Also das Raid hast Du auf der Karte erzeugt? Das solltest Du nicht tun, reiche die Platten per JBOD durch und mach das Raid auf Proxmox-Ebene (Software).

fstrankowski replied to the thread [SOLVED] Proxmox und VM auf einem Laufwerk?./dev/sda ist bei Dir ein Raid über die MR Karte? Also das Raid hast Du auf der Karte erzeugt? Das solltest Du nicht tun, reiche die Platten per JBOD durch und mach das Raid auf Proxmox-Ebene (Software). -

fstrankowski reacted to Johannes S's post in the thread Proxmox 9.1.5 breaks LXC mount points? with

fstrankowski reacted to Johannes S's post in the thread Proxmox 9.1.5 breaks LXC mount points? with Like.

This was exactly my point I wanted to make since somebody in this thread argued that things like the current isse might led to companies considering PVE not "production-ready" for enterprise environments. And this is nonsense: In an enterprise...

Like.

This was exactly my point I wanted to make since somebody in this thread argued that things like the current isse might led to companies considering PVE not "production-ready" for enterprise environments. And this is nonsense: In an enterprise... -

fstrankowski replied to the thread [SOLVED] Proxmox und VM auf einem Laufwerk?.Ich weiß ja nicht, mit welchem Dateisystem du Proxmox jetzt installiert hast :-) Entweder Du hast "local-lvm", oder "local-zfs" bei Dir, da werden die VMs dann mittels Blockstorage angelegt.

fstrankowski replied to the thread [SOLVED] Proxmox und VM auf einem Laufwerk?.Ich weiß ja nicht, mit welchem Dateisystem du Proxmox jetzt installiert hast :-) Entweder Du hast "local-lvm", oder "local-zfs" bei Dir, da werden die VMs dann mittels Blockstorage angelegt. -

fstrankowski replied to the thread [SOLVED] Proxmox und VM auf einem Laufwerk?.Kannst Du so machen. Wenn Du deine Hardware auflistest können wir dir sicher noch Ideen für eine gute Partitionierung geben.

fstrankowski replied to the thread [SOLVED] Proxmox und VM auf einem Laufwerk?.Kannst Du so machen. Wenn Du deine Hardware auflistest können wir dir sicher noch Ideen für eine gute Partitionierung geben. -

fstrankowski replied to the thread Mountpoints for LXC containers broken after update.It is a bug and has since been fixed (fix waiting approval). Non volume mountpoints (e.g. externally mounted) are excluded in the future from changing file-permissions when bound. Means attribute-preservation will get removed for these kind of...

fstrankowski replied to the thread Mountpoints for LXC containers broken after update.It is a bug and has since been fixed (fix waiting approval). Non volume mountpoints (e.g. externally mounted) are excluded in the future from changing file-permissions when bound. Means attribute-preservation will get removed for these kind of... -

fstrankowski replied to the thread LXC Fails to start when using read-only Mountpoint.Most probably: https://bugzilla.proxmox.com/show_bug.cgi?id=7271 Please try downgrading pve-container like that apt install pve-container=6.0.18 which should fix the problem. A patch is already on the way.

fstrankowski replied to the thread LXC Fails to start when using read-only Mountpoint.Most probably: https://bugzilla.proxmox.com/show_bug.cgi?id=7271 Please try downgrading pve-container like that apt install pve-container=6.0.18 which should fix the problem. A patch is already on the way. -

fstrankowski replied to the thread HA Shutdown nach dem Backup einer abgeschalteten VM?.Meistens liegt es an nicht zuzverlässigen Netzwerk-Storages (wie bei dir die NetApp). Hier wird es zu Problemen & Abbrüchen bei den Backups kommen. Bitte probier deine Backups einmal durch, nur weil Sie da aufgelistet sind heißt es ja nicht, dass...

fstrankowski replied to the thread HA Shutdown nach dem Backup einer abgeschalteten VM?.Meistens liegt es an nicht zuzverlässigen Netzwerk-Storages (wie bei dir die NetApp). Hier wird es zu Problemen & Abbrüchen bei den Backups kommen. Bitte probier deine Backups einmal durch, nur weil Sie da aufgelistet sind heißt es ja nicht, dass... -

fstrankowski replied to the thread nächtliche Aktivitäten - "hoher" IO Pressure Stall.Wir können dir ja nicht sagen was dein Server oder deine VMs um 4 Uhr Nachts tun, das kannst nur Du selbst wissen. Du hast ja nicht einmal mitgeteilt um was für Container oder VMs es sich handelt, was darauf läuft usw. usf. Fahre den doch nachts...

fstrankowski replied to the thread nächtliche Aktivitäten - "hoher" IO Pressure Stall.Wir können dir ja nicht sagen was dein Server oder deine VMs um 4 Uhr Nachts tun, das kannst nur Du selbst wissen. Du hast ja nicht einmal mitgeteilt um was für Container oder VMs es sich handelt, was darauf läuft usw. usf. Fahre den doch nachts... -

fstrankowski replied to the thread Is there a mechanism that could cause a node to shutdown?.You can lose 2 nodes but the cluster does not quorate anymore and thus VMs "stand still" because noone "knows" if whats happening is what is supposed to happen in the cluster :) Thats the reason there is a quorum in the first place, so that...

fstrankowski replied to the thread Is there a mechanism that could cause a node to shutdown?.You can lose 2 nodes but the cluster does not quorate anymore and thus VMs "stand still" because noone "knows" if whats happening is what is supposed to happen in the cluster :) Thats the reason there is a quorum in the first place, so that... -

fstrankowski replied to the thread Is there a mechanism that could cause a node to shutdown?.You didnt even notice that a node rebooted and rejoined your cluster (which after you deleted it should NEVER happen because this can ruin your cluster). IMHO there is more broken then i can see as of now. You could try to remove the node from...

fstrankowski replied to the thread Is there a mechanism that could cause a node to shutdown?.You didnt even notice that a node rebooted and rejoined your cluster (which after you deleted it should NEVER happen because this can ruin your cluster). IMHO there is more broken then i can see as of now. You could try to remove the node from...